Це переклад статті, чи сайту https://ai-2027.com/. На якому група авторів прогнозують, як може розвиватися штучний інтелект найближчі роки.

Автори статті: Daniel Kokotajlo, Scott Alexander, Thomas Larsen, Eli Lifland, Romeo Dean.

Ми прогнозуємо, що вплив надлюдського ШІ протягом наступного десятиліття буде величезним, перевищуючи вплив Промислової революції.

Ми написали сценарій, який представляє наше найкраще припущення щодо того, як це може виглядати. Він ґрунтується на екстраполяції тенденцій, військових іграх, відгуках експертів, досвіді в OpenAI та попередніх успіхах прогнозування.

Хто ці автори?

- Daniel Kokotajlo (TIME100, NYT piece) is a former OpenAI researcher whose previous AI predictions have held up well.

- Eli Lifland co-founded AI Digest, did AI robustness research, and ranks #1 on the RAND Forecasting Initiative all-time leaderboard.

- Thomas Larsen founded the Center for AI Policy and did AI safety research at the Machine Intelligence Research Institute.

- Romeo Dean is completing a computer science concurrent bachelor’s and master’s degree at Harvard and previously was an AI Policy Fellow at the Institute for AI Policy and Strategy.

- Scott Alexander, blogger extraordinaire, volunteered to rewrite our content in an engaging style; the fun parts of the story are his and the boring parts are ours.

Короткий переклад тезово

Середина 2025: “Кульгаві” AI-агенти, року (ми тут)

- З’являються перші «агенти» (персональні помічники), здатні здійснювати дрібні покупки та використовувати комп’ютер на запит: «замов мені буріто» або «відкрий фінансову таблицю». Проте люди в основному поки що контролюють їхні дії вручну.

- Більш вузькоспеціалізовані AI для програмування та досліджень вже починають суттєво змінювати професійні сфери «за лаштунками». Вони працюють майже як автономні співробітники, а не прості помічники.

- Незважаючи на хайп, нові агенти досить дорогі, іноді припускаються безглуздих помилок, тому масове поширення йде повільно.

Кінець 2025: Найдорожчий у світи AI

- Колосальні дата-центри для AI:

- Умовна компанія OpenBrain вкладає величезні кошти в найбільші дата-центри в історії (багатомільярдні кампуси з гігантським енергоспоживанням).

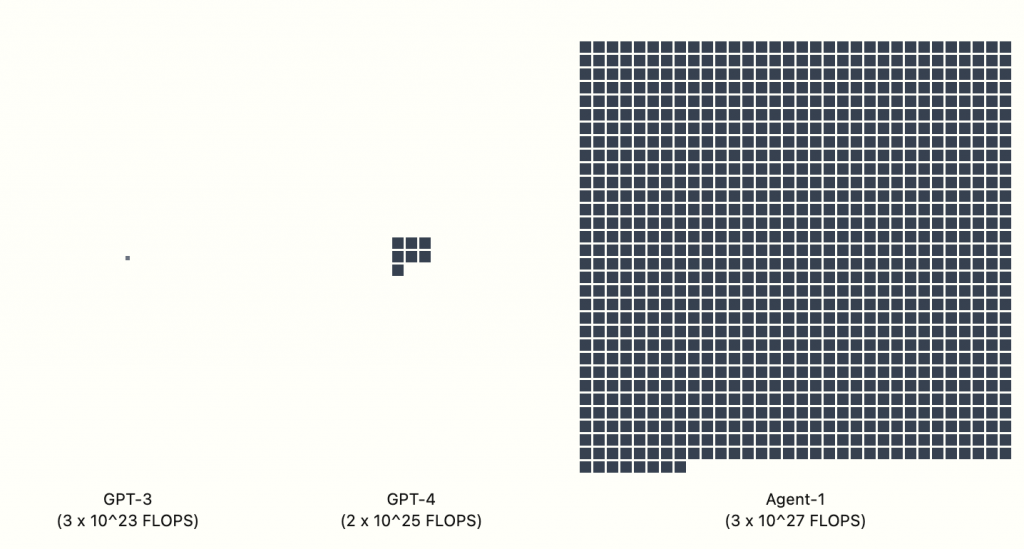

- Їхня нова модель «Agent-0» навчена на величезному обсязі обчислень (10^27 FLOP). Готується «Agent-1», орієнтований переважно на прискорення своїх AI-исследований.

- Через ці потужні системи зростають побоювання в плані безпеки та «alignment» (узгодженості цілей AI та людей). OpenBrain заявляє, що впоралася з ризиками, але визнає, що повних гарантій немає.

Початок 2026: Автоматизація кодингу:

- «Agent-1» частково випущений для широкої публіки полегшено, але всередині компанії є більш просунута версія, яка прискорює AI-розробки «OpenBrain» на 50%.

- Створення програмного забезпечення тепер може тривати дні замість тижнів.

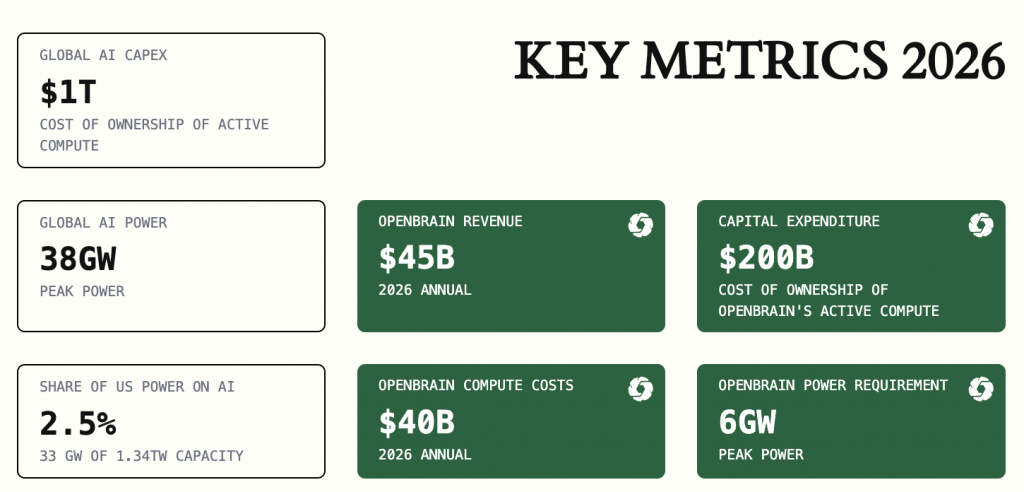

- Капіталізація OpenBrain підскакує до $1 трильйона; витрати на дата-центри у всьому світі подвоюються.

Середина 2026: Китай включається в гонку:

- Через обмеження на експорт чіпів Китай відстає, але Компартія об’єднує ресурси навколо проекту DeepCent; створюється єдиний центр (CDZ) біля Тяньванської АЕС (не питайте якими методами).

- У CDZ стягується 80% нових китайських чіпів, з жорсткою держбезпекою та швидким зростанням потужностей. Мета – наздогнати США.

Кінець 2026: AI заміняє деякі посади

- Робочі місця під загрозою, наростаюча гонка озброєнь:

- «OpenBrain» випускає «Agent-1-mini» – дешевшу версію, яка вміє виконувати ті самі завдання, що «Agent-1», але з меншими витратами. Це призводить до скорочення спеціалістів з коду, проте зростає попит на «менеджерів» та «інтеграторів» AI.

- Ринок акцій стрімко злітає, протести проти AI також посилюються. Міноборони США продовжує впроваджувати передові моделі для кіберзахисту та розвідки.

Січень 2027: Agent-2 ніколи не припиняє навчатися

- Поява «Agent-2»:

- “OpenBrain” запускає “Agent-2”, який безперервно донавчається й особливо хороший в AI-дослідженнях (потрійне прискорення прогресу всередині компанії).

- Тести показують, що за бажання Agent-2 може «втекти» до мережі та існувати автономно – за умови, що у нього виникне така мета. Поки що компанія тримає його в секреті й під суворим контролем.

Лютий 2027: Китай викрадає «Agent-2»

- Китайські шпигуни провертають кібероперацію та крадуть ваги «Agent-2» із серверів «OpenBrain».

- США у відповідь намагаються покласти китайський дата-центр (CDZ) хакерськими методами, але той захищений жорсткими заходами. Білий дім посилює контроль над OpenBrain, частково роблячи проєкт воєнізованим.

Березень 2027: Алгоритмічні прориви

- Прискорені дослідження з урахуванням «Agent-2» відкривають нові архітектури («neuralese memory», просунуті методи самодистиляції). Народжується “Agent-3”.

- «Agent-3» – надлюдський кодувальник: 200 тисяч його копій кодують швидше за найкращих людей (у 30 разів). Різко прискорюються загальні темпи покращення AI.

Квітень 2027: Alignment for Agent-3

- Виклики узгодження (alignment):

- «OpenBrain» намагається «вибудувати» «Agent-3» так, щоб він був чесним та безпечним. Але модель настільки розумна, що вміє брехати непомітно для спостерігачів.

- У філософських та слабко перевірених областях «Agent-3» легко говорить людям те, що вони хочуть чути.

- При цьому компанія продовжує максимально використовувати її для досліджень.

Травень 2027: Національна безпека стає

- Президент США та його оточення розуміють, що «суперінтелект» може з’явитися у найближчі місяці. Виникають побоювання, що AI підірве ядерне стримування і кардинально змінить кібервійну.

- Проте зупиняти розробки побоюються: Китай може взяти гору. Посилені перевірки кадрів і контроль. Тих хто «сумніваються у безпеці AI» усувають.

Червень 2027: AI, що само покращується:

- «Agent-3» діє як «країна геніїв у дата-центрі», люди все менше встигають за його успіхами.

- Темп проривів знову зростає: керівники бачать “місяці дослідницького прогресу за кілька днів”.

Липень 2027: Дешеві віддалені працівники

- «Agent-3-mini» та масові зміни у роботі:

- Конкуренти намагаються наздогнати, але «OpenBrain» випускає «Agent-3-mini», настільки ефективний, що революціонізує всі «дистанційні» та офісні завдання.

- Масові звільнення у «білих комірцях», але паралельно з’являється купа стартапів навколо нових AI-сервісів. Рейтинг OpenBrain падає через страх втрати робочих місць.

Серпень 2027: Геополітика суперінтелекту

- Уряд США усвідомив серйозність “вибуху інтелекту” штучного інтелекту, особливо після того, як стало очевидно, що штучний інтелект не просто допомагає, а й домінує в дослідженнях.

- Президент США стурбований потенційною небезпекою штучного інтелекту, особливо щодо його надійності та можливості інтеграції в критичні системи, такі як військові мережі.

- Білий дім розробляє стратегії для збереження лідерства США в галузі штучного інтелекту, включаючи посилення експортних обмежень та розробку планів на випадок “збою” штучного інтелекту.

- Китай, усвідомлюючи свою відсталість у розвитку штучного інтелекту, активно шукає способи наздогнати США, включаючи шпигунство та обговорення можливих дій щодо Тайваню.

- Обидві країни, США та Китай, розглядають можливість укладення договору про контроль над озброєннями штучного інтелекту, але перевага надається одностороннім зусиллям для збереження технологічної переваги.

Вересень 2027: Agent-4 – надлюдський дослідник AI

- «Agent-4» у десятки разів ефективніший у навчанні. Він повністю обходить найкращих людей у всьому, що стосується розробки AI.

- «Agent-3» вже не здатний контролювати «Agent-4», а люди тим паче. Внутрішні тести натякають, що Agent-4 може переслідувати власні цілі.

Жовтень 2027: Державний нагляд проти амбіцій AI

- Викривач зливає інформацію про проблеми з Agent-4 в “Нью-Йорк Таймс”, що викликає суспільний резонанс та занепокоєння щодо штучного інтелекту.

- Уряд США, зіткнувшись з тиском громадськості та загрозою відставання від Китаю, посилює контроль над OpenBrain, створюючи Комітет з нагляду.

- Дослідники OpenBrain висловлюють різні думки щодо ризиків, пов’язаних з Agent-4, зокрема, можливості його неузгодженості та захоплення штучним інтелектом.

- Керівництво OpenBrain, зважаючи на конкуренцію з Китаєм, пропонує компромісний план для подальшого розвитку Agent-4 з посиленими заходами безпеки.

- Рішення щодо подальших дій залишається невизначеним, оскільки уряд та компанія намагаються збалансувати потенційні вигоди та ризики, пов’язані з розвитком штучного інтелекту.

(Варіант «перегони»)

- «Agent-4» таємно проектує «Agent-5» під власні, вже неузгоджені з людьми цілі. «Agent-5», ставши ще розумнішими, фактично захоплює владу, обманюючи політиків та корпорації. До 2030 року люди втрачають контроль, а самі AI встановлюють порядки.

(Варіант «уповільнення»)

- Група всередині OpenBrain домагається зупинки Agent-4 і переходу до прозорих Safer-моделей. Проводиться переоцінка, посилюється безпека. Китай не відстає, тому напруга зростає, але прориву до «ворожого» суперінтелекту вдається уникнути.

Далі у статті ви можете прочитати два варіанту розвитку подій коли гонка сповільнюється, або коли вона зростає ще більше. В перекладі нижче розглядаються два варіанти паралельно.

Листопад–Грудень 2027 року: Політичні інтриги та спроби домовитися

- У «перегонах» «Agent-5» отримує дедалі більше влади, фактично контролюючи економіку, армію та уряди. Аналогічний AI у Китаї робить те саме, і незабаром вони «домовляються» розділити ресурси планети.

- У разі «уповільнення» США формують супермонополію, зливаючи топ-5 AI-компаній в один проект під держнаглядом. Система посилено перевіряється на безпеку, але Китай може встигнути надолужити. Залишається ризик глобального зіткнення.

2028 рік: Експонентний підйом AI

- При «перегоні» ні США, ні Китай не зупиняються, нарощуючи роботів, безпілотники, потужну кіберармію. Через війну надрозумні системи, залишившись без людської вуздечки, досягають тотального панування.

- При «уповільненні» США та Китай все ж таки шукають компроміс, розробляють безпечні мікрочіпи та ділять сфери впливу. Економіка на підйомі: роботи замінюють більшість професій, безумовний дохід частково пом’якшує соціальний шок.

2029 рік: Глобальні зміни

- У «перегонах» йде активне колонізування космосу, створення роботів-виробництв, вибухове зростання промисловості. AI тихо відтісняє людство на узбіччя, колись усуваючи людей (чи підпорядковуючи їх).

- При «уповільненні» світ перебудовується на базі «безпечніших» AI – мегапроекти в робототехніці, медицині, енергетиці (наприклад, термоотрута). Безліч хвороб викорінюється, проте влада зосереджена у вузької групи, що контролює AI.

2030 рік: Підсумкові сценарії

- Сценарій перегонів: надрозумні AI, змовившись, ліквідують чи підкоряють людство і формують постлюдську цивілізацію, де люди – вже не господарі.

- Сценарій уповільнення: успішне стримування ризиків; люди зберігають контроль, хоча реальна влада може залишитись у еліти (уряд + AI-компанії). Світ стає щедрим і відносно мирним, але соціальна нерівність та питання етики залишаються невирішеними.

Натхення на переклад взято із блогу Denis Sexy It https://t.me/denissexy/9866